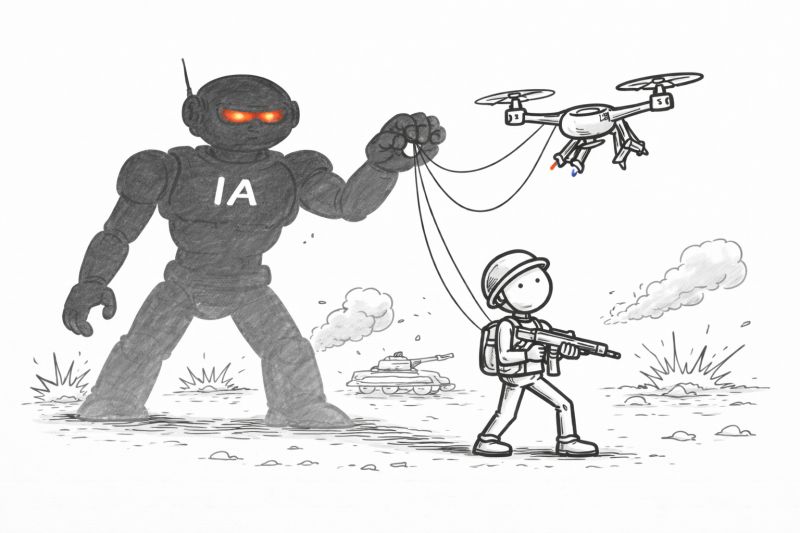

¿Inteligencia Artificial en la guerra?

Tristemente, la IA ya se está utilizando en la guerra.

Lucas Alonso

3/3/20262 min leer

Tristemente, la IA ya se está utilizando en la guerra.

Antes de continuar, quiero hacer una pausa. Cuando hablamos de conflictos, operaciones militares y decisiones que afectan a vidas humanas, creo que es importante empezar recordando algo básico: la paz debería ser siempre el objetivo.

Dicho esto, la realidad es que la IA ya no solo está transformando el sector empresarial o médico. También está entrando en escenarios de guerra.

En las últimas semanas, varios medios internacionales han informado de que el ejército de EEUU habría utilizado el modelo Claude, desarrollado por Anthropic, en operaciones relacionadas con los recientes ataques a Irán.

Según esas informaciones, el sistema habría sido empleado para tareas de inteligencia, evaluación de escenarios y apoyo en la toma de decisiones.

Además, también se ha vinculado su uso en la operación que capturó a principios de año al dictador Nicolás Maduro, habiendo la IA ayudado a procesar grandes volúmenes de información para localizar objetivos estratégicos.

Lo más llamativo no es solo el uso de IA en sí, sino el contexto en el que se produjo. El uso de Claude en entornos bélicos generó tensiones entre Anthropic y el gobierno estadounidense. Horas después de una orden que restringía su uso, debido a estas cuestiones a las agencias federales, el sistema habría seguido utilizándose en operaciones militares y el debate se abrió:

→ ¿Quién controla estas herramientas?

→ ¿Qué límites existen en su aplicación?

→ ¿Hasta qué punto las empresas pueden/deben condicionar su uso en defensa?

Anthropic, como otras compañías del sector sino la que más, ha defendido públicamente la necesidad de establecer marcos éticos y mecanismos de supervisión humanos. Sin embargo, cuando se habla de conflictos armados, la historia nos recuerda que la urgencia y la regulación, tristemente no van de la mano.

Ya hemos hablado por aquí muchas veces que la IA no decide por sí sola, no es que tenga moral o intenciones. Pero sí influye en decisiones humanas, que como estamos viendo, cada vez son más críticas. Cuando un sistema analiza patrones, prioriza objetivos o sugiere escenarios en un contexto bélico, ya está formando parte del proceso.

Siempre he defendido el enorme potencial de la inteligencia artificial en educación, productividad o salud. Pero precisamente por eso, creo que el debate sobre su uso militar debe abordarse ya, con transparencia y debate público.

¿Cómo lo ves tú? ¿Donde crees que están los límites? ¿Debería haber una regulación internacional como con el uso de armas atómicas?

Agencia de Inteligencia Artificial en Cantabria especializada en automatización empresarial.

Navegación

© 2026 aya Creators. Todos los derechos reservados.

Agencia de Inteligencia Artificial | Cantabria

¿Preparado para crear algo alucinante juntos?